Das Jetpack XR SDK enthält alle Tools und Bibliotheken, die Sie zum Erstellen immersiver und erweiterter Erlebnisse für Android XR‑Geräte benötigen.

Vollständig immersive Erlebnisse erstellen

Richten Sie sich an spezielle Geräte mit hoher Wiedergabetreue wie XR‑Headsets und kabelgebundene XR‑Datenbrillen. Verwenden Sie moderne Android-Entwicklungstools wie Kotlin und Compose, sowie Tools der vorherigen Generation wie Java und Views. Sie können Ihre UI räumlich darstellen, 3D-Modelle laden und rendern und die reale Welt semantisch verstehen.

Wenn Sie bereits eine App für Mobilgeräte oder große Bildschirme auf Android haben, bringt das Jetpack XR SDK Ihre App in eine neue Dimension, indem es vorhandene Layouts räumlich darstellt und Ihre Erlebnisse mit 3D-Modellen und immersiven Umgebungen verbessert. In unseren Qualitätsrichtlinien finden Sie Empfehlungen zur räumlichen Darstellung Ihrer vorhandenen Android-App.

Erweiterte und hilfreiche Erlebnisse erstellen

Richten Sie sich an leichte und stilvolle Datenbrillen mit Audio- und Displayfunktion. Verwenden Sie moderne Android-Entwicklungstools wie Kotlin und Jetpack Compose Glimmer. Verwenden Sie APIs, die projizierte App-Erlebnisse von einem Smartphone auf die Datenbrille ermöglichen.

Jetpack-Bibliotheken verwenden

Die Bibliotheken des Jetpack XR SDK bieten ein umfassendes Toolkit zum Erstellen von umfangreichen, immersiven Erlebnissen, leichten, erweiterten Erlebnissen und allem dazwischen. Die folgenden Bibliotheken sind Teil des Jetpack XR SDK:

- Jetpack Compose for XR: Erstellen Sie deklarativ räumliche UI-Layouts , die die räumlichen Funktionen von Android XR nutzen.

- **Material Design for XR**: Erstellen Sie Material-Komponenten und -Layouts , die für XR angepasst sind.

- **Jetpack SceneCore**: Erstellen und bearbeiten Sie den Android XR-Szenengraphen mit 3D-Inhalten.

- ARCore for Jetpack XR: Bringen Sie digitale Inhalte mit Wahrnehmungsfunktionen in die reale Welt.

- **Jetpack Compose Glimmer**: Ein UI-Toolkit zum Erstellen erweiterter Android XR-Erlebnisse, optimiert für Datenbrillen mit Displayfunktion.

- **Jetpack Projected**: APIs, die projizierte App-Erlebnisse von einem Smartphone auf Datenbrillen mit Audio- oder Displayfunktion ermöglichen.

API-Entwicklung während der Entwicklervorschau

Die Bibliotheken des Jetpack XR SDK sind Teil der Android XR-Entwicklervorschau und diese APIs werden noch entwickelt. Bekannte Probleme finden Sie in den Versionshinweisen zur Bibliothek:

- Versionshinweise zu Jetpack Compose for XR

- Versionshinweise zu ARCore for Jetpack XR

- Versionshinweise zu Jetpack SceneCore

- Versionshinweise zur XR-Laufzeit

- Versionshinweise zu Jetpack Compose Glimmer

- Versionshinweise zu Jetpack Projected

Wenn ein Problem auftritt, das nicht in einer dieser Listen enthalten ist, melden Sie einen Fehler oder senden Sie Feedback.

Jetpack Compose for XR

Anwendbare XR‑Geräte: XR‑Headsets, kabelgebundene XR‑Datenbrillen

Mit Jetpack Compose for XR können Sie vertraute Compose-Konzepte wie Zeilen und Spalten verwenden, um räumliche UI-Layouts in XR zu erstellen. Das gilt sowohl für das Portieren einer vorhandenen 2D-App zu XR als auch für das Erstellen einer neuen XR-App von Grund auf.

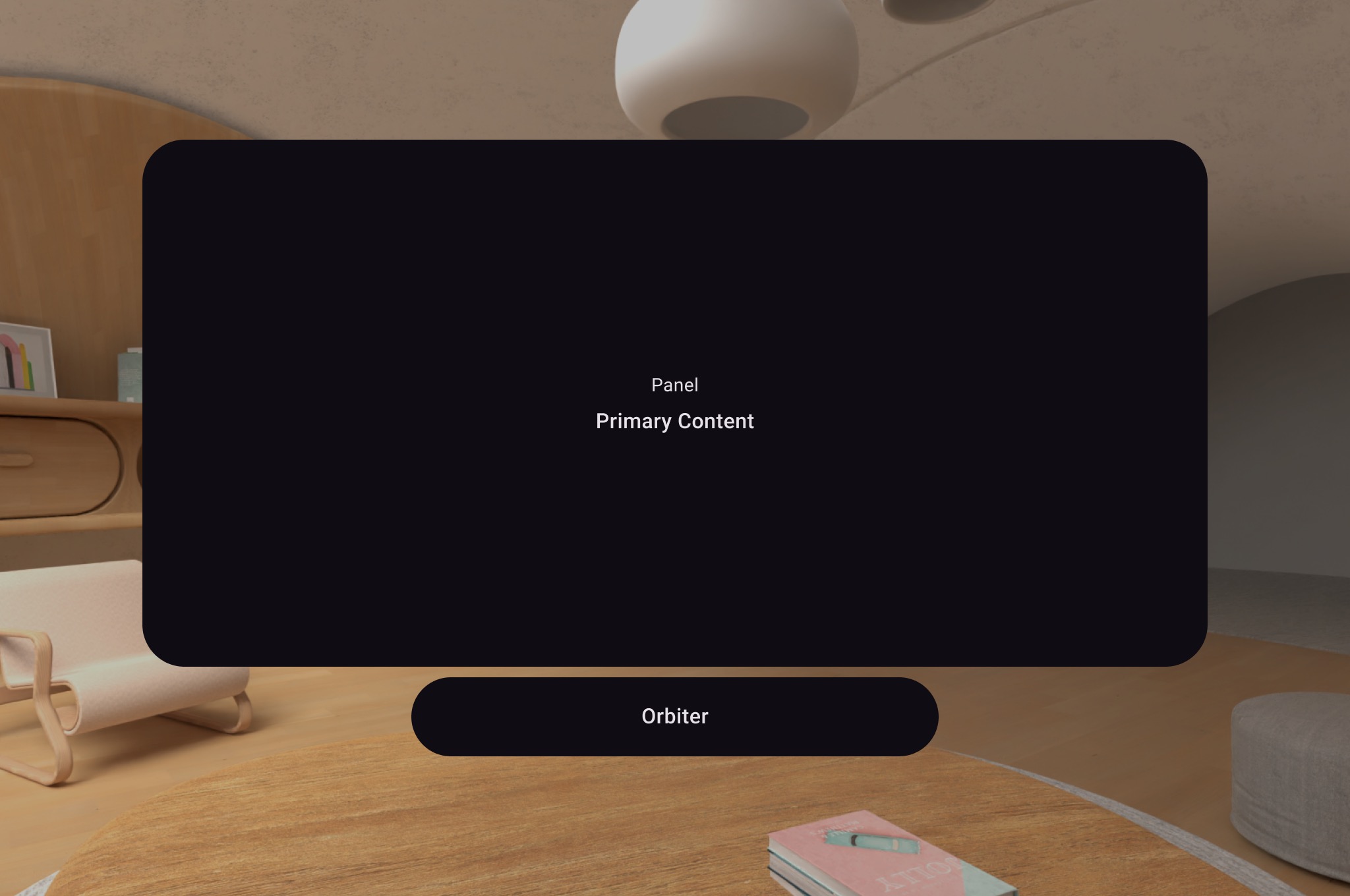

Diese Bibliothek bietet Unterraum-Komposables wie räumliche Panels und Orbiter, mit denen Sie Ihre vorhandene 2D-UI auf Compose- oder Views-Basis in einem räumlichen Layout platzieren können.

Eine detaillierte Anleitung finden Sie unter UI mit Jetpack Compose for XR entwickeln.

Compose for XR führt das SceneCoreEntity Unterraum-Composable ein, mit dem Sie Entitäten platzieren können, wie z. B. 3D-Modelle, relativ zu Ihrer UI.

Informationen zum räumlichen Darstellen Ihrer vorhandenen Android-App oder zur API-Referenz finden Sie hier.

Material Design for XR

Anwendbare XR‑Geräte: XR‑Headsets, kabelgebundene XR‑Datenbrillen

Material Design bietet Komponenten und Layouts, die für XR angepasst sind. Wenn Sie mit adaptiven Layouts arbeiten. Weitere Informationen zur Implementierung von Material Design for XR.

Jetpack SceneCore

Anwendbare XR‑Geräte: XR‑Headsets, kabelgebundene XR‑Datenbrillen

Mit der Jetpack SceneCore-Bibliothek können Sie 3D-Inhalte, die durch Entitäten definiert werden, relativ zueinander und zu Ihrer Umgebung platzieren und anordnen. Mit SceneCore können Sie Folgendes tun:

- Legen Sie räumliche Umgebungen fest

- Instanzen einer

PanelEntityerstellen - 3D-Modelle platzieren und animieren

- Räumliche Audioquellen angeben

- Komponenten zu Entitäten hinzufügen, die sie beweglich und in der Größe veränderbar machen und in der realen Welt verankert werden können

Die Jetpack SceneCore-Bibliothek bietet auch Unterstützung für die räumliche Darstellung von Apps, die mit Views erstellt wurden. Weitere Informationen finden Sie in unserem Leitfaden zur Verwendung von Ansichten für mehr Details.

Weitere Informationen finden Sie in der API-Referenz.

ARCore for Jetpack XR

XR‑Geräte, für die der Leitfaden gilt: XR‑Headsets, kabelgebundene XR‑Datenbrillen, Datenbrillen mit Audiofunktion, Datenbrillen mit Displayfunktion

Die ARCore for Jetpack XR-Bibliothek ist von der vorhandenen ARCore-Bibliothek inspiriert und bietet Funktionen zum Einblenden digitaler Inhalte in die reale Welt. Diese Bibliothek umfasst Bewegungserkennung, persistente Anker, Treffertests und Ebenenerkennung mit semantischer Kennzeichnung (z. B. Boden, Wände und Tischplatten). Diese Bibliothek nutzt den zugrunde liegenden Wahrnehmungsstack, der von OpenXR unterstützt wird. Dadurch wird die Kompatibilität mit einer Vielzahl von Geräten gewährleistet und Apps sind zukunftssicher.

Weitere Informationen finden Sie unter Mit ARCore for Jetpack XR arbeiten.

Jetpack Compose Glimmer

XR‑Geräte, für die der Leitfaden gilt: Datenbrillen mit Displayfunktion

Jetpack Compose Glimmer ist ein UI-Toolkit zum Erstellen erweiterter Android XR-Erlebnisse, optimiert für Datenbrillen mit Displayfunktion. Erstellen Sie eine ansprechende, minimalistische und komfortable UI für Geräte, die den ganzen Tag getragen werden.

- Für schnelle Erfassung und Lesbarkeit entwickelt: Im Gegensatz zu Smartphones ist die primäre Canvas ein optisches See-Through-Display – es ist transparent. Jetpack Compose Glimmer bietet spezielle Designs für Datenbrillen, vereinfachte Farb paletten und Typografie, damit Ihre Inhalte leicht zu lesen und schnell zu verarbeiten sind und nicht ablenken.

- Für tragbare Geräte optimierte Interaktionen: Wir haben Interaktionsmodelle für die Verwendung von Datenbrillen optimiert. Die Jetpack Compose Glimmer Komponenten bieten klare Fokusstatus, z. B. optimierte Umrisse anstelle von ablenkenden Ripple-Effekten, und sind für gängige physische Eingaben wie Tippen, Wischen auf dem Rahmen und natürlich Sprache entwickelt.

- Vertraute deklarative UI-Muster verwenden: Da Jetpack Compose Glimmer vollständig auf Jetpack Composebasiert, können Sie alles verwenden, was Sie bereits über die deklarative UI-Erstellung in Android wissen. Wir bieten eine vollständige Reihe von vordefinierten Composable-Kernfunktionen wie „Text“, „Symbol“, „Schaltfläche“ und spezielle Komponenten wie „TitleChip“, die alle für die Datenbrillenumgebung optimiert sind.

Jetpack Projected

XR‑Geräte, für die der Leitfaden gilt: Datenbrillen mit Audiofunktion, Datenbrillen mit Displayfunktion

Wenn Sie für Datenbrillen mit Audio- und Displayfunktion entwickeln, wird Ihre App auf einem Begleitgerät Hostgerät ausgeführt, z. B. einem Android-Smartphone, das die XR Erlebnisse Ihrer App projiziert. Mit Jetpack Projected können diese Android-Hostgeräte mit Datenbrillen mit Audio- oder Displayfunktion kommunizieren, wenn die Hostgeräte über projizierte XR-Funktionen verfügen.

- Auf Hardware des projizierten Geräts zugreifen: Ein Gerätekontext, der mit dem projizierten Gerät (Datenbrille mit Audio- oder Displayfunktion) verknüpft ist. Dieser projizierte Kontext bietet Zugriff auf die Hardware des projizierten Geräts, z. B. die Kamera. Spezielle Aktivitäten, die speziell für die Anzeige auf Datenbrillen mit Audio- oder Displayfunktion erstellt wurden, fungieren bereits als projizierter Kontext. Wenn ein anderer Teil Ihrer App (z. B. eine Smartphone-Aktivität oder ein Dienst) auf die Hardware der Datenbrille zugreifen muss, kann er einen projizierten Kontext abrufen.

- Berechtigungsanfragen vereinfachen: Datenbrillen mit Audio- und Displayfunktion folgen dem Standardmodell für Android-Berechtigungen. Es gibt spezielle Berechtigungen für Datenbrillen, die zur Laufzeit angefordert werden müssen, bevor Ihre App auf die Gerätehardware wie die Kamera zugreifen kann. Der Berechtigungshelfer optimiert diese Mechanismen für Berechtigungsanfragen sowohl für die Smartphone- als auch für die Datenbrillenoberfläche, um eine einheitliche Anfrage zu ermöglichen.

- Geräte- und Displayfunktionen prüfen: Prüfen Sie, ob das projizierte Gerät ein Display hat und wie der Status des Displays ist, um Visualisierungen zu präsentieren. Passen Sie Ihre App an die Funktionen des Geräts an. Beispielsweise können Sie mehr Audio-Kontext bereitstellen, wenn das Gerät kein Display hat oder das Display ausgeschaltet ist.

- Auf Kameraaktionen der App zugreifen: Ihre App kann auf Kameraaktionen des Nutzers zugreifen, z. B. um die Kamera in einer Videostreaming-App ein- oder auszuschalten.

OpenXR™ und das OpenXR-Logo sind Marken von The Khronos Group Inc. und sind als Marke in China, der Europäischen Union, Japan und dem Vereinigten Königreich eingetragen.