Die Augmented-Reality-Funktionen von Google Glass sind eine Erweiterung Ihrer bestehenden mobilen App. Sie können Übergabefunktionen von Ihrer mobilen App zu Google Glass erstellen. Ihre App kann sowohl auf der AI Glasses als auch auf der Display AI Glasses ausgeführt werden.

KI‑Brille mit Display

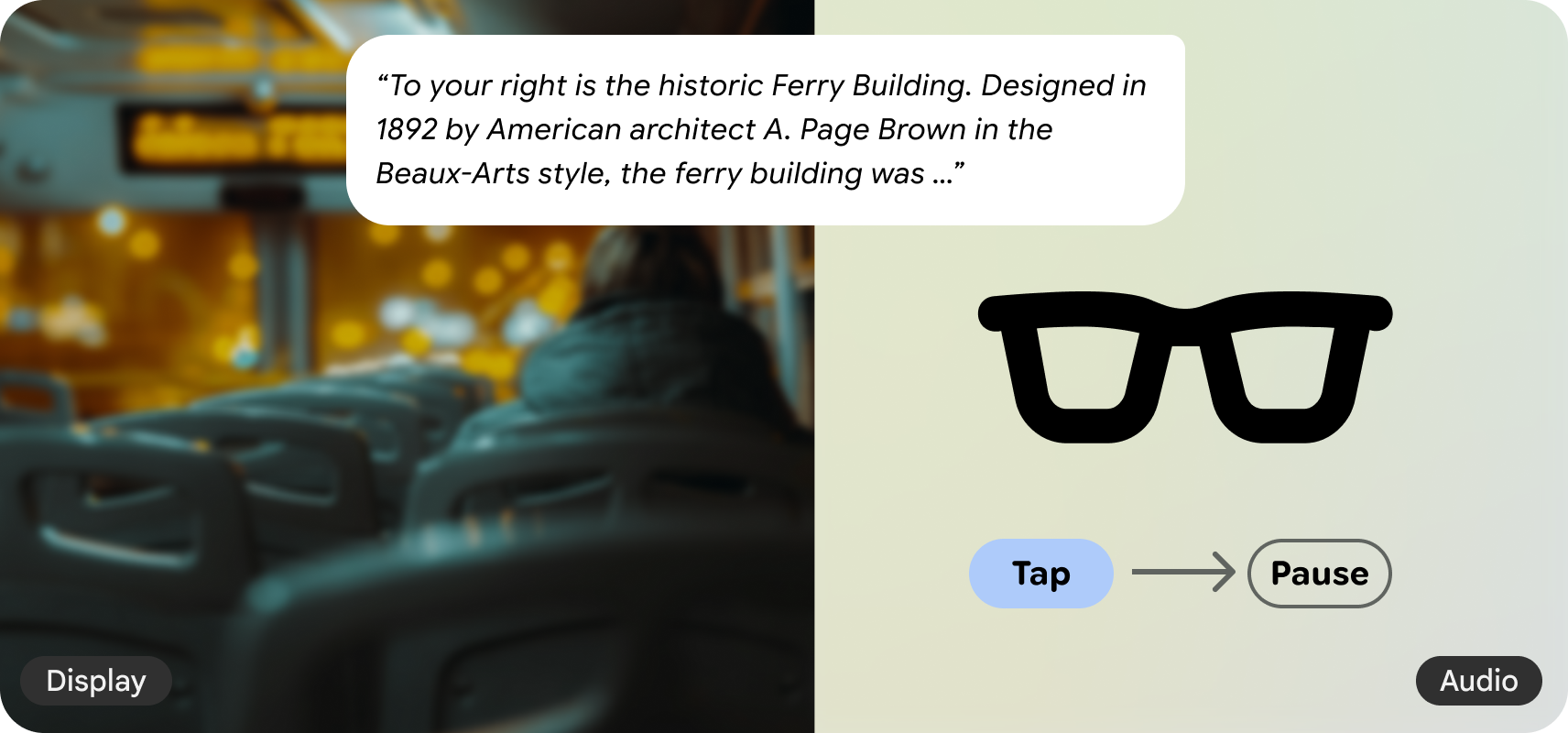

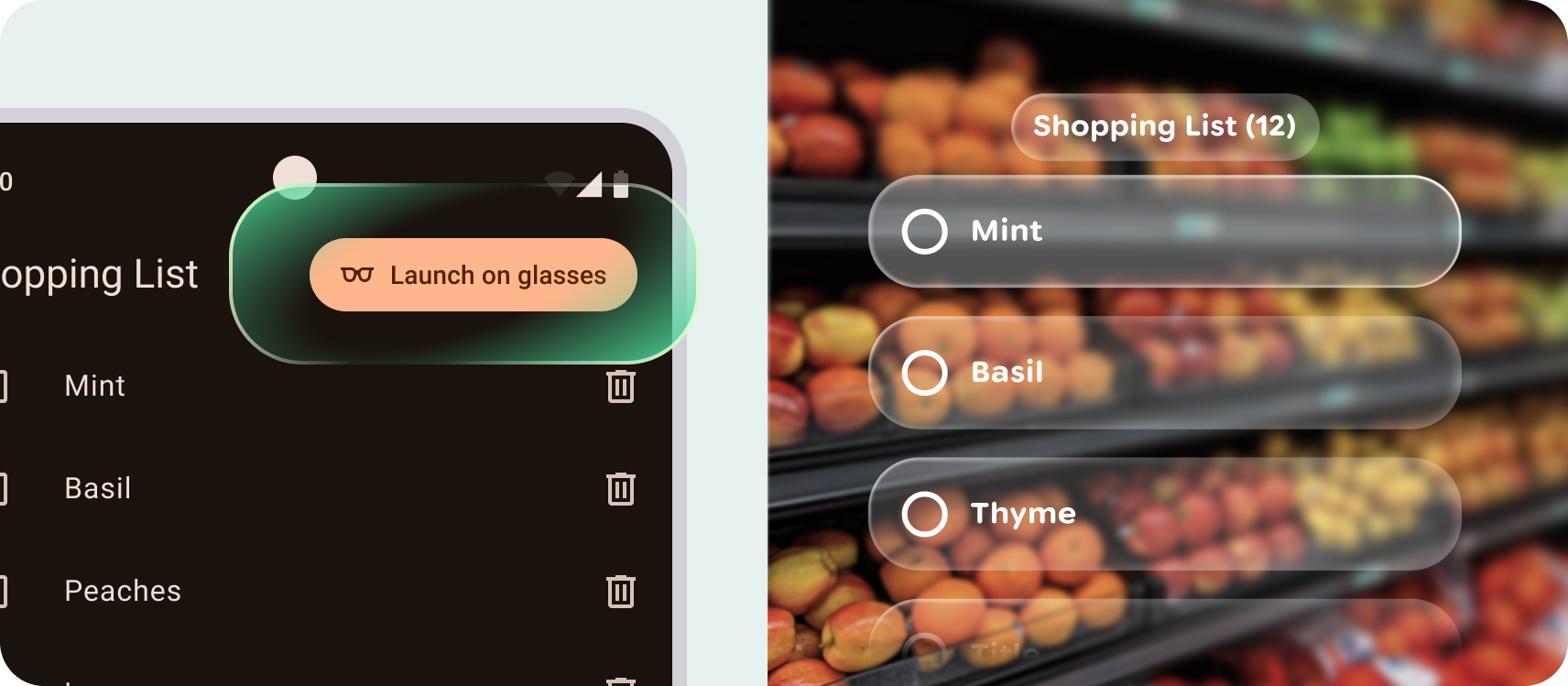

Brillen mit Display bieten ein visuelles und Audioerlebnis. Ihre App sollte daher sowohl visuelle als auch akustische Hinweise enthalten.

Wenn das Display eingeschaltet ist, kann der Nutzer mit dem Touchpad interagieren, um Listen zu scrollen, den Fokus zu verschieben, auf Schaltflächen zu klicken usw. Geben Sie visuelles Feedback, um die Sinne des Nutzers nicht mit zu viel Audiofeedback zu überfordern.

Wenn das Display ausgeschaltet ist, kann Ihre App nachverfolgen, ob das Display ein- oder ausgeschaltet ist. So kann der Nutzer zwischen Display- und Audioinhalten wechseln.

Zeitüberschreitung für Display

Nutzer können das Display durch Drücken der Displaytaste ausschalten oder warten, bis das Display automatisch in den Ruhemodus wechselt. Das Zeitlimit kann von Nutzern konfiguriert oder für Ihre App angepasst werden. Passen Sie es nur an, wenn es für die Nutzerfreundlichkeit Ihrer App unbedingt erforderlich ist, da dies die Leistung beeinträchtigen kann.

Auf displaylosen KI-Brillen

Displayless-Anzeigen werden an die Audioausgabe angepasst.

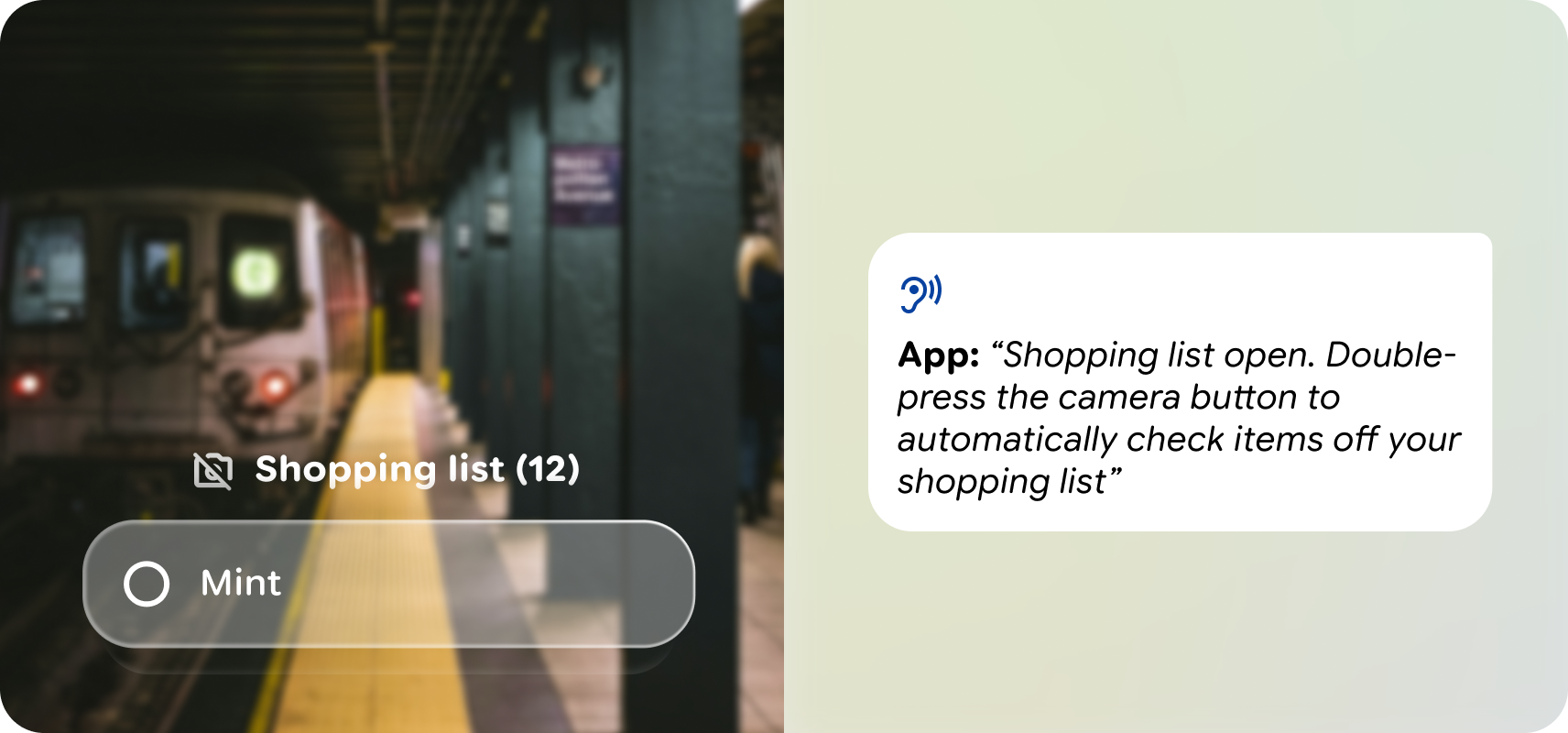

- Die Eingabe wird wichtigen Aktionen zugeordnet, z. B. dem Starten oder Pausieren der Wiedergabe durch Tippen und dem Beenden von Inhalten durch Zurückwischen. Da es keine UI-Elemente gibt, mit denen auf einem Display einzeln interagiert werden kann. Auf gerätelosen Oberflächen kann der Nutzer beispielsweise nicht durch eine Liste von Optionen und mehreren Schaltflächen scrollen. Stattdessen benötigt er einen Audio-Cue mit einer möglichen entsprechenden Eingabe. Weitere Informationen zur Eingabe

- Visuelle Hinweise in Audiohinweise umwandeln

- Ihre Nutzer haben möglicherweise Brillen, die nur ein Display oder nur Audio bieten. Daher ist es wichtig, Audio- und visuelle Abläufe für Ihre App zu berücksichtigen.

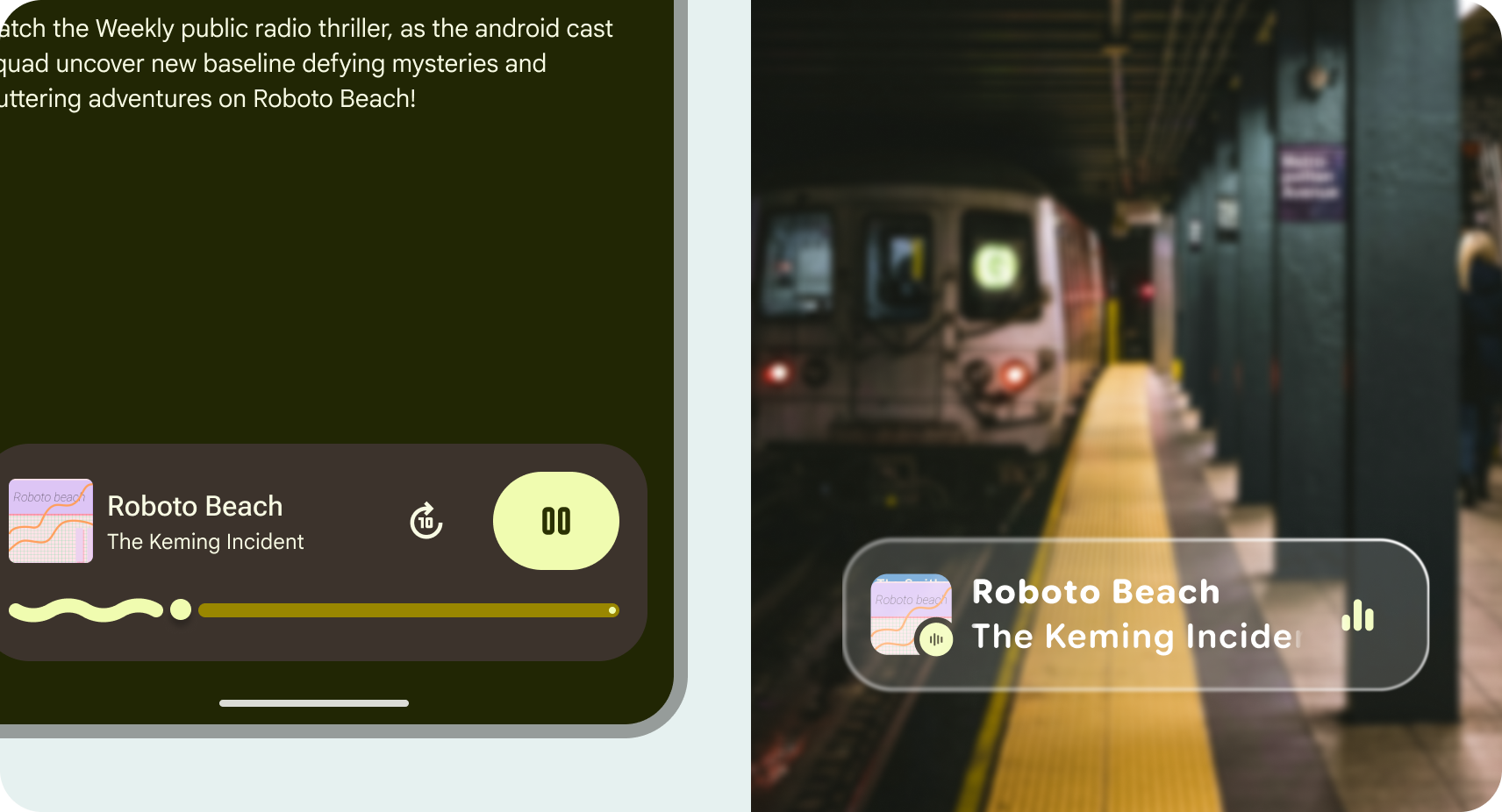

Bei KI-Brillen mit Display wird beispielsweise nach dem Starten der App eine visuelle Benutzeroberfläche geladen, während bei KI-Brillen mit Audio ein Audio-Cue den Nutzer zu einer appweiten Interaktion auffordert.

Hier wird die Audioausgabe durch die visuelle Benutzeroberfläche auf der Brille pausiert, während ein Hardware-Eingabetipp nur bei Audio pausiert.

Audio-Interaktionen für KI-Brillen entwickeln

App-Anatomie

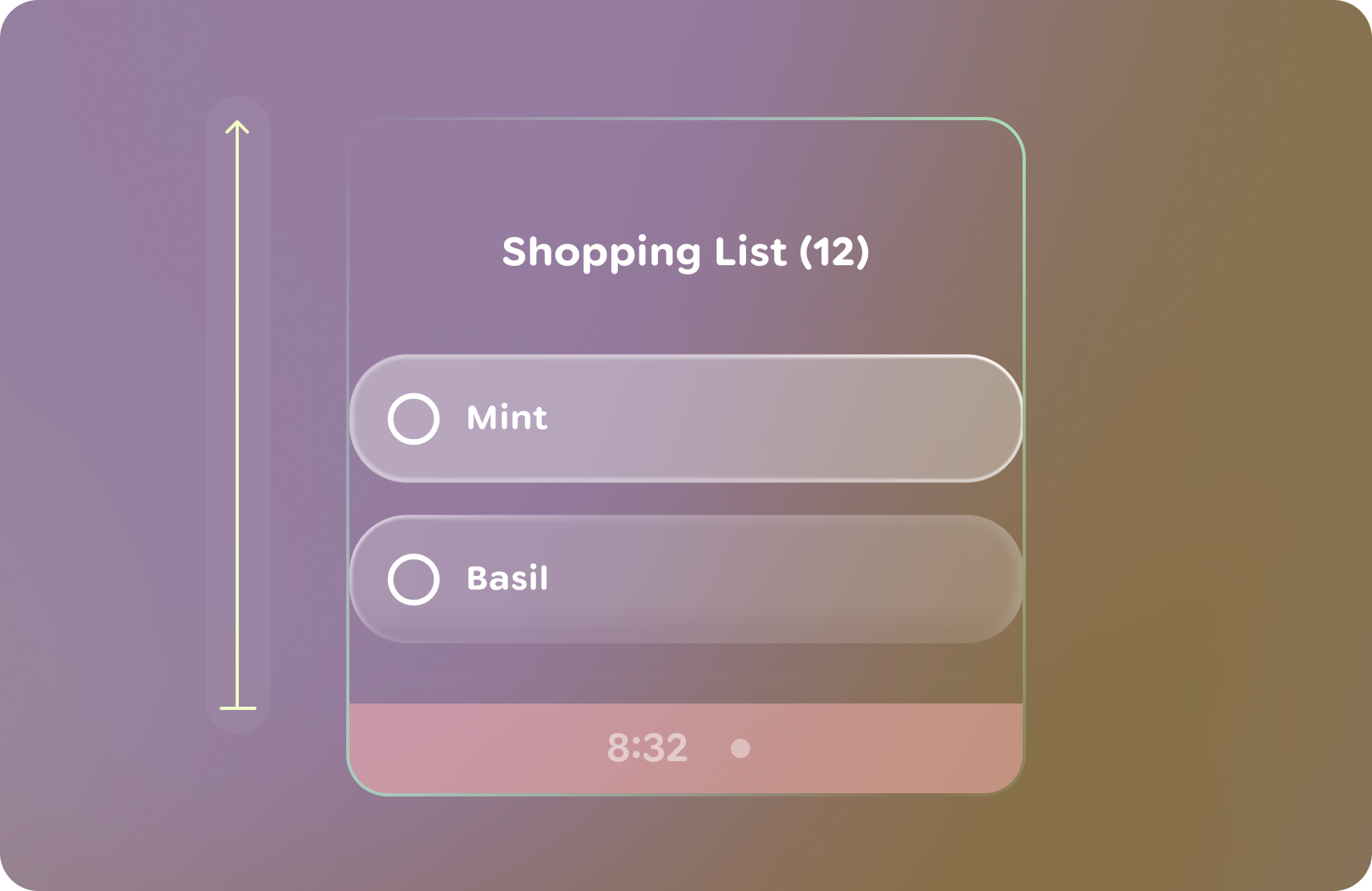

Die Brillenoberfläche wird von unten nach oben aufgebaut, um die Sichtlinie des Nutzers zu erweitern, anstatt sie zu blockieren.

- Verankern Sie beim Entwerfen Ihrer App Elemente am unteren Rand des Canvas, um nach oben zu arbeiten.

- Inhalte sollten nicht vertikal zentriert sein und möglichst wenig Text enthalten, damit sie die Nutzer nicht ablenken.

- Tiefe wird für die visuelle Hierarchie verwendet.

- Außer für Benachrichtigungen dürfen Apps den Bereich der Systemleiste nicht verwenden. Wenn sie nicht verwendet wird, ist sie unsichtbar.

- Apps können scrollen, aber versuchen Sie, die Anzahl der Elemente zu minimieren, um die kognitive Belastung zu reduzieren und Interaktionen auf dem Display zu minimieren.

- Wägen Sie ab, wie viel Sprachinteraktion erforderlich ist, und ob physische Gesten nicht manchmal besser sind.

Einstiegspunkte

Da deine Smartwatch-App eine Erweiterung deiner Haupt-App ist, solltest du die Übergabe vom Smartphone als primären Einstiegspunkt in Betracht ziehen. Da sich die Formfaktoren der Brille weiterentwickeln, können Sie in Zukunft mit weiteren Einstiegspunkten über die System-UI oder KI-Funktionen rechnen.

Übergabe vom Smartphone

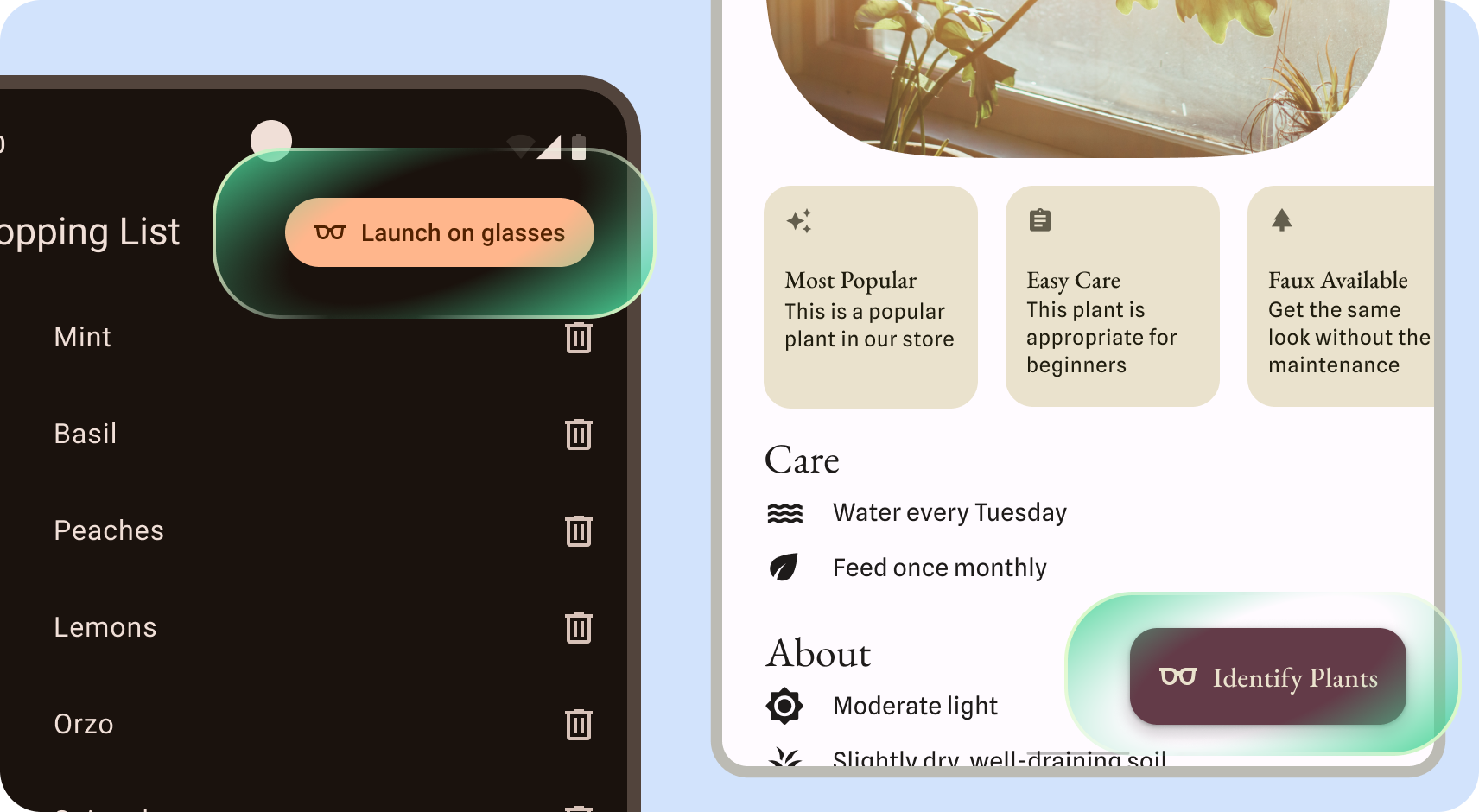

Sie können eine App auf Ihrer Brille über Ihr Smartphone starten, indem Sie eine explizite Aktion ausführen oder die Übergabe implizit erfolgt.

Implizite Übergabe kann automatisch als natürlicher Teil eines Nutzerablaufs erfolgen, um einen Teil der Brillenfunktionen zu starten. Wenn Sie beispielsweise die Navigation starten, wird auf der Brille eine detaillierte Routenführung angezeigt. Bei der Medienwiedergabe wird auf der Brille eine visuelle Anzeige eingeblendet.

Für die explizite Übergabe ist eine Nutzerinteraktion in der mobilen App erforderlich, um die Brillen-App zu starten. Beispielsweise durch Ein-/Ausschalten der Kamera über die App oder über eine Schaltfläche, mit der die Brillen-App gestartet wird. Verwenden Sie dazu ein Brillensymbol und optional das Label „Auf Brille starten“.

Personalisierung

Apps auf Brillen bieten Flexibilität bei der User Experience und dem UI-Design.

Das UI-Framework bietet eine hochoptimierte Basisgruppe von Komponenten wie Listen und Karten sowie Basisstile wie Farbe und Typografie. Alle Anpassungen sollten sorgfältig vorgenommen werden, um Nutzern Informationen zu vermitteln oder Ihre Marke widerzuspiegeln.

Weitere Informationen zu Glimmer-Stilen in Jetpack Compose