Wenn Sie Ihrer App benutzerdefinierte Bilder hinzufügen, können Sie die Nutzerfreundlichkeit deutlich verbessern und personalisieren und so die Nutzerinteraktionen steigern. In diesem Beitrag werden zwei neue Funktionen für die Bildgenerierung mit Firebase AI Logic vorgestellt: die speziellen Imagen-Bearbeitungsfunktionen, die sich derzeit in der Vorschau befinden, und die allgemeine Verfügbarkeit von Gemini 2.5 Flash Image (auch bekannt als „Nano Banana“), das für die kontextbezogene oder dialogorientierte Bildgenerierung entwickelt wurde.

Nutzerinteraktionen mit Bildern steigern, die mit Firebase AI Logic generiert wurden

Mit Bildgenerierungsmodellen können Sie benutzerdefinierte Avatare für Nutzerprofile erstellen oder personalisierte visuelle Assets direkt in wichtige Bildschirmabläufe einbinden.

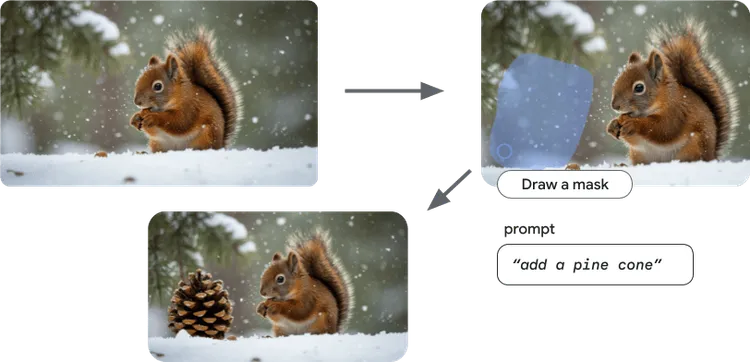

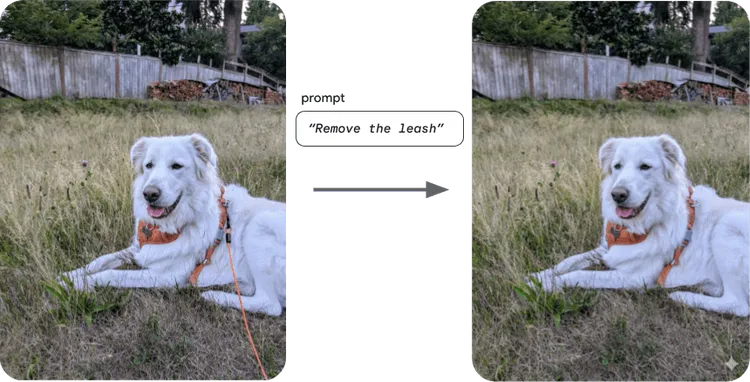

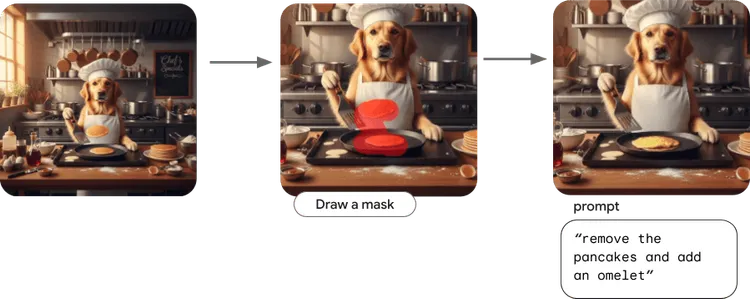

Imagen bietet beispielsweise neue Bearbeitungsfunktionen (in der Entwicklervorschau). Sie können jetzt eine Maske zeichnen und Inpainting verwenden, um Pixel im maskierten Bereich zu generieren. Außerdem ist Outpainting verfügbar, um Pixel außerhalb der Maske zu generieren.

Imagen unterstützt Inpainting, sodass Sie nur einen Teil eines Bildes generieren können.

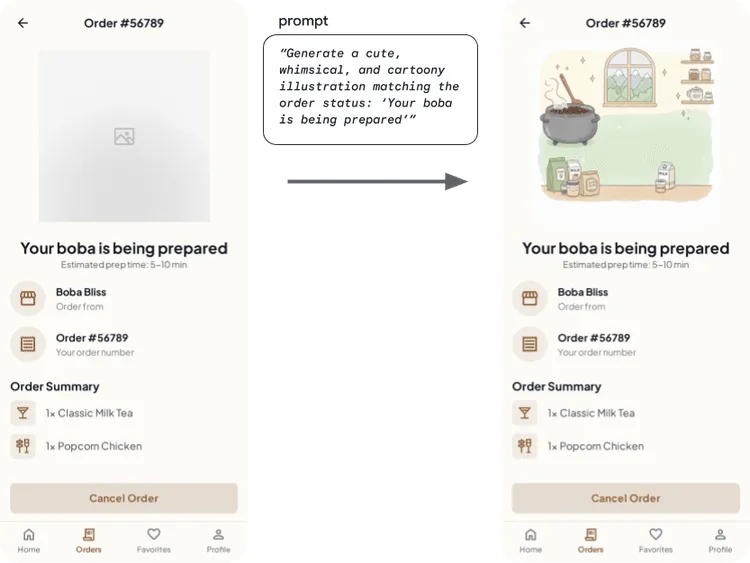

Alternativ kann Gemini 2.5 Flash Image (auch bekannt als „Nano Banana“) das erweiterte Allgemeinwissen und die Logikfunktionen der Gemini-Modelle nutzen, um kontextbezogene Bilder zu generieren. Das ist ideal für die Erstellung dynamischer Illustrationen, die zur aktuellen In-App-Erfahrung eines Nutzers passen.

Mit Gemini 2.5 Flash Image können Sie dynamische Illustrationen erstellen, die für Ihre App relevant sind.

Außerdem können Nutzer Bilder dialogorientiert und iterativ bearbeiten, indem sie natürliche Sprache verwenden.

Mit Gemini 2.5 Flash Image können Sie Bilder mit natürlicher Sprache bearbeiten.

Wenn Sie KI in Ihre Anwendung einbinden, ist es wichtig, sich mit KI-Sicherheit vertraut zu machen. Sie sollten insbesondere die Sicherheitsrisiken Ihrer Anwendung bewerten, Anpassungen zur Minimierung von Sicherheitsrisiken in Betracht ziehen, Sicherheitstests durchführen, die für Ihren Anwendungsfall geeignet sind, Nutzerfeedback einholen und Inhalte überwachen.

Imagen oder Gemini: Sie haben die Wahl

Der Unterschied zwischen Gemini 2.5 Flash Image ("Nano Banana") und Imagen liegt im primären Fokus und den erweiterten Funktionen. Gemini 2.5 Flash Image ist ein Bildmodell innerhalb der größeren Gemini-Familie, das sich durch dialogorientierte Bildbearbeitung auszeichnet. Es behält den Kontext und die Konsistenz des Motivs über mehrere Iterationen hinweg bei und nutzt Allgemeinwissen und Logikfunktionen, um kontextbezogene Bilder zu erstellen oder genaue Bilder in lange Textsequenzen einzubetten.

Imagen ist das spezielle Bildgenerierungsmodell von Google, das für mehr kreative Kontrolle entwickelt wurde. Es ist auf fotorealistische Ausgaben, künstlerische Details und bestimmte Stile spezialisiert und bietet explizite Steuerelemente zum Festlegen des Seitenverhältnisses oder Formats des generierten Bildes.

| Gemini 2.5 Flash Images (Nano Banana 🍌) | Imagen |

🌎 Allgemeinwissen und Logikfunktionen für kontextbezogenere Bilder 💬 Bilder dialogorientiert bearbeiten und dabei den Kontext beibehalten 📖 Genaue Bilder in lange Textsequenzen einbetten | 📐 Seitenverhältnis oder Format generierter Bilder festlegen

🖌️ Unterstützung der maskenbasierten Bearbeitung für Inpainting und Outpainting

🎚️ Mehr Kontrolle über Details des generierten Bildes (Qualität, künstlerische Details und bestimmte Stile) |

Sehen wir uns an, wie Sie sie in Ihrer App verwenden können.

Inpainting mit Imagen

Vor einigen Monaten haben wir neue Bearbeitungsfunktionen für Imagen veröffentlicht. Imagen ist jetzt für die Bildgenerierung bereit für die Produktion, die Bearbeitungsfunktionen befinden sich jedoch noch in der Entwicklervorschau.

Zu den Imagen-Bearbeitungsfunktionen gehören Inpainting und Outpainting, maskenbasierte Bildbearbeitungsfunktionen. Mit dieser neuen Funktion können Nutzer bestimmte Bereiche eines Bildes ändern, ohne das gesamte Bild neu generieren zu müssen. So können Sie die besten Teile Ihres Bildes beibehalten und nur das ändern, was Sie ändern möchten.

Mit den Imagen-Bearbeitungsfunktionen können Sie präzise gezielte Änderungen an einem Bild vornehmen und die Integrität des restlichen Bildes gewährleisten.

Diese Änderungen werden vorgenommen, während die Kernelemente und die allgemeine Integrität des Originalbildes beibehalten werden. Nur der Bereich in der Maske wird geändert.

Um Inpainting mit Imagen zu implementieren, initialisieren Sie zuerst imagen-3.0-capability-001, ein bestimmtes Imagen-Modell, das Bearbeitungsfunktionen unterstützt:

// Copyright 2025 Google LLC.

// SPDX-License-Identifier: Apache-2.0

val editingModel =

Firebase.ai(backend = GenerativeBackend.vertexAI()).imagenModel(

"imagen-3.0-capability-001",

generationConfig = ImagenGenerationConfig(

numberOfImages = 1,

aspectRatio = ImagenAspectRatio.SQUARE_1x1,

imageFormat = ImagenImageFormat.jpeg(compressionQuality = 75),

),

)

Definieren Sie dann die Inpainting-Funktion:

// Copyright 2025 Google LLC.

// SPDX-License-Identifier: Apache-2.0

val prompt = "remove the pancakes and make it an omelet instead"

suspend fun inpaintImageWithMask(sourceImage: Bitmap, maskImage: Bitmap, prompt: String, editSteps: Int = 50): Bitmap {

val imageResponse = editingModel.editImage(

referenceImages = listOf(

ImagenRawImage(sourceImage.toImagenInlineImage()),

ImagenRawMask(maskImage.toImagenInlineImage()),

),

prompt = prompt,

config = ImagenEditingConfig(

editMode = ImagenEditMode.INPAINT_INSERTION,

editSteps = editSteps,

),

)

return imageResponse.images.first().asBitmap()

}

Sie geben sowohl ein Quellbild als auch ein Maskenbild und einen Prompt für die Bearbeitung sowie die Anzahl der auszuführenden Bearbeitungsschritte an.

Sie können es in Aktion im Imagen-Bearbeitungsbeispiel im Android AI Sample-Katalog sehen.

Imagen unterstützt auch Outpainting , mit dem Sie das Modell die Pixel außerhalb einer Maske generieren lassen können. Sie können auch die Bildanpassungsfunktionen von Imagen verwenden, um den Stil eines Bildes zu ändern oder ein Motiv in einem Bild zu aktualisieren. Weitere Informationen finden Sie in der Android-Entwicklerdokumentation.

Dialogorientierte Bildgenerierung mit Gemini 2.5 Flash Image

Eine Möglichkeit, Bilder mit Gemini 2.5 Flash Image zu bearbeiten, besteht darin, die Multi-Turn-Chat-Funktionen des Modells zu verwenden.

Initialisieren Sie zuerst das Modell:

// Copyright 2025 Google LLC.

// SPDX-License-Identifier: Apache-2.0

val model = Firebase.ai(backend = GenerativeBackend.googleAI()).generativeModel(

modelName = "gemini-2.5-flash-image",

// Configure the model to respond with text and images (required)

generationConfig = generationConfig {

responseModalities = listOf(ResponseModality.TEXT,

ResponseModality.IMAGE)

}

)

Um ein ähnliches Ergebnis wie bei der oben beschriebenen maskenbasierten Imagen-Methode zu erzielen, können wir die chat-API verwenden, um eine Unterhaltung mit Gemini 2.5 Flash Image zu starten.

// Copyright 2025 Google LLC.

// SPDX-License-Identifier: Apache-2.0

// Initialize the chat

val chat = model.startChat()

// Load a bitmap

val source = ImageDecoder.createSource(context.contentResolver, uri)

val bitmap = ImageDecoder.decodeBitmap(source)

// Create the initial prompt instructing the model to edit the image

val prompt = content {

image(bitmap)

text("remove the pancakes and add an omelet")

}

// To generate an initial response, send a user message with the image and text prompt

var response = chat.sendMessage(prompt)

// Inspect the returned image

var generatedImageAsBitmap = response

.candidates.first().content.parts.filterIsInstance<ImagePart>().firstOrNull()?.image

// Follow up requests do not need to specify the image again

response = chat.sendMessage("Now, center the omelet in the pan")

generatedImageAsBitmap = response

.candidates.first().content.parts.filterIsInstance<ImagePart>().firstOrNull()?.image

Sie können es in Aktion im Gemini Image Chat-Beispiel im Android AI Sample-Katalog sehen und weitere Informationen in der Android-Dokumentation lesen.

Schlusswort

Sowohl Imagen als auch Gemini 2.5 Flash Image bieten leistungsstarke Funktionen, mit denen Sie je nach Anwendungsfall das ideale Bildgenerierungsmodell auswählen können, um Ihre App zu personalisieren und die Nutzerinteraktionen zu steigern.

Weiterlesen

-

Produktneuheiten

Wenn Sie Android-Entwickler sind und innovative KI-Funktionen in Ihre App einbinden möchten, haben wir vor Kurzem leistungsstarke neue Updates veröffentlicht.

Thomas Ezan • Lesezeit: 3 Minuten

-

Produktneuheiten

Heute erweitern wir die Gemini 3-Modellfamilie mit der Veröffentlichung von Gemini 3 Flash, einer bahnbrechenden KI, die auf Geschwindigkeit ausgelegt ist und nur einen Bruchteil der Kosten verursacht.

Thomas Ezan • Lesezeit: 2 Minuten

-

Produktneuheiten

Das mobile Ökosystem entwickelt sich ständig weiter und bringt sowohl neue Möglichkeiten als auch neue Bedrohungen mit sich. Android und Google Play sorgen dafür, dass Milliarden von Nutzern ihre Apps weiterhin mit Zuversicht nutzen können und Entwicklerinnovationen gefördert werden.

Vijaya Kaza • Lesezeit: 3 Minuten

Auf dem Laufenden bleiben

Lassen Sie sich Woche für Woche die neuesten Informationen zur Android-Entwicklung zusenden.