Gemini Nano 可讓您提供豐富的生成式 AI 體驗,不必連上網路,也不必將資料傳送至雲端。如果主要考量是低成本和隱私權保護措施,裝置端 AI 就是絕佳解決方案。

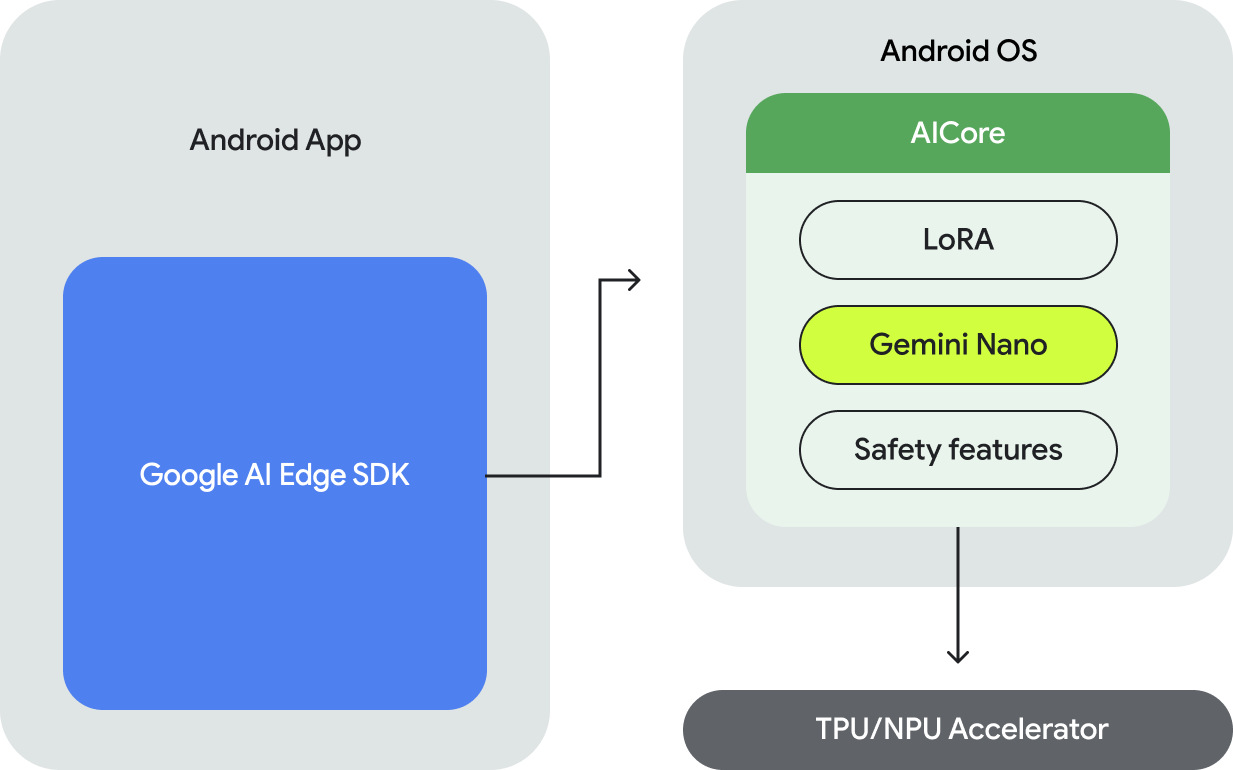

如要用於裝置端用途,可以善用 Google 的 Gemini Nano 基礎模型。Gemini Nano 會在 Android 的 AICore 系統服務中執行,運用裝置硬體來縮短推論延遲時間,並確保模型維持在最新狀態。

ML Kit GenAI API

ML Kit 的 GenAI API 運用 Gemini Nano 的強大功能,協助應用程式執行工作。這些 API 提供高階介面,可直接用於熱門用途,確保品質。ML Kit GenAI API 建構於 AICore 之上,這項 Android 系統服務可在裝置端執行生成式 AI 基礎模型,以利處理本地資料,進而強化應用程式功能和提升使用者隱私。瞭解詳情。

主要功能

ML Kit GenAI API 支援下列功能:

- 提示:根據自訂的純文字或多模態提示生成文字內容。

- 重點摘要:以項目符號清單的形式摘要文章或對話。

- 校對:校對簡短的即時通訊訊息。

- 改寫:以不同語氣或風格改寫簡短的即時通訊訊息。

- 圖片說明:生成指定圖片的簡短說明。

- 語音辨識:將語音音訊轉錄為文字。

透過 AICore 進行架構設計

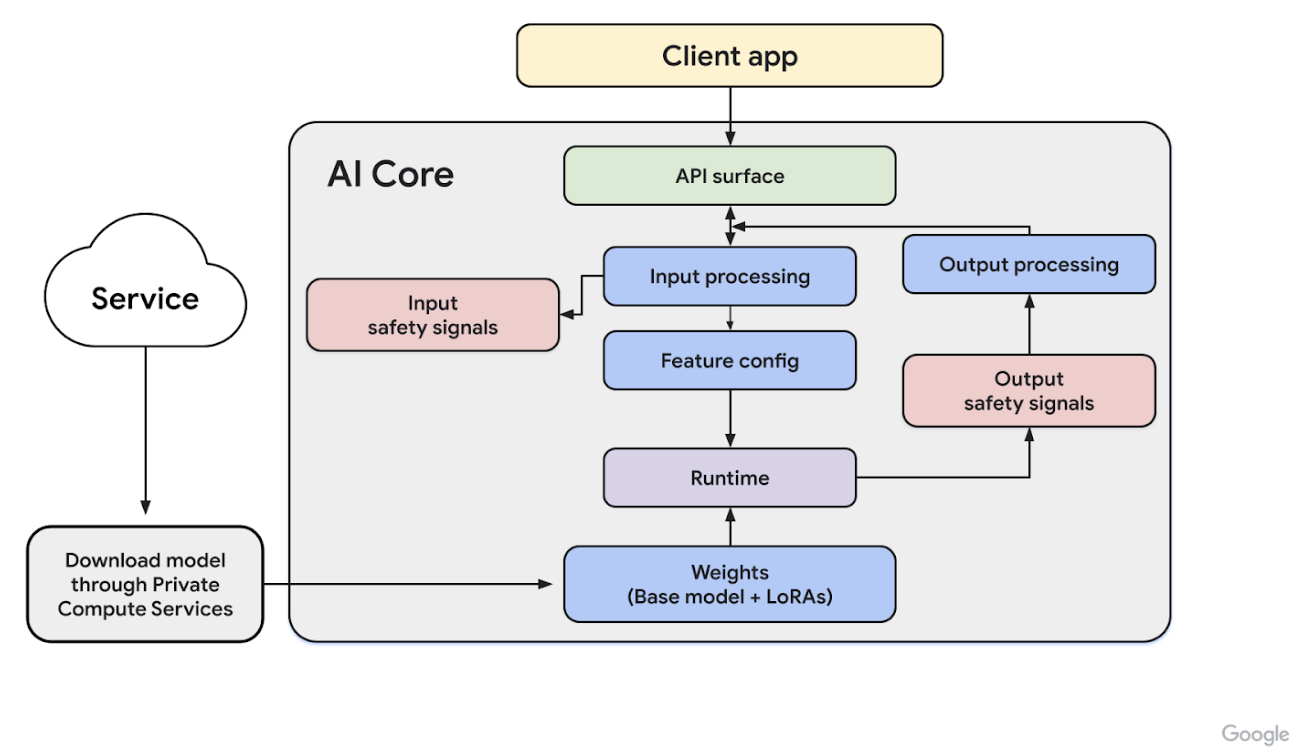

AICore 是系統層級的模組,您可透過一系列 API 存取 AICore,在裝置端執行推論。此外,AICore 內建多項安全防護功能,可確保系統根據安全防護篩選器進行全面評估。下圖說明應用程式如何存取 AICore,在裝置端執行 Gemini Nano。

保護使用者資料的私密性與安全性

裝置端生成式 AI 會在本機執行提示,因此不會呼叫伺服器。 雖然這樣可以解決網路延遲問題,但推論速度取決於裝置硬體。這項做法可將敏感資料保留在裝置上,提升隱私權防護、啟用離線功能,並降低推論成本。

AICore 遵循 Private Compute Core 原則,主要特點如下:

- 受限的套件繫結:AICore 與大多數其他套件隔離,但特定系統套件除外。只有在 Android 完整 OTA 更新期間,才能修改這份允許清單。

- 間接存取網際網路:AICore 無法直接存取網際網路。 所有網際網路要求 (包括模型下載) 都會透過開放原始碼的 Private Compute Services 隨附 APK 轉送。Private Compute Services 中的 API 必須明確展現以隱私權為中心的特性。

此外,AICore 的設計可隔離每個要求,且處理輸入資料或產生的輸出內容後,不會儲存任何記錄,以保護使用者隱私。詳情請參閱「Gemini Nano 隱私權和安全性簡介」網誌文章。

透過 AICore 存取 AI 基礎模型的好處

AICore 讓 Android 作業系統能夠提供及管理 AI 基礎模型。這項功能可大幅降低在應用程式中使用這些大型模型的成本,主要原因如下:

- 輕鬆部署:AICore 會管理 Gemini Nano 的發布作業,並處理日後的更新。您不必擔心透過網路下載或更新大型模型,也不會影響應用程式的磁碟和執行階段記憶體預算。

- 加速推論:AICore 會運用裝置端硬體加速推論。應用程式在每部裝置上都能發揮最佳效能,您也不必擔心底層硬體介面。