Android 14 bietet tolle Funktionen und APIs für Entwickler. Im Folgenden finden Sie Informationen zu Funktionen für Ihre Apps und zu den ersten Schritten mit den zugehörigen APIs.

Eine detaillierte Liste der hinzugefügten, geänderten und entfernten APIs finden Sie im Bericht „API-Unterschiede“. Weitere Informationen zu hinzugefügten APIs finden Sie in der Android API-Referenz. Suchen Sie unter Android 14 nach APIs, die mit API-Level 34 hinzugefügt wurden. Informationen dazu, in welchen Bereichen sich Plattformänderungen auf deine Apps auswirken können, findest du unter Android 14-Verhaltensänderungen für Apps, die auf Android 14 ausgerichtet sind und für alle Apps.

Lokalisierung

App-spezifische Spracheinstellungen

Android 14 erweitert die in Android 13 (API-Level 33) eingeführten pro App-Sprache um folgende Funktionen:

localeConfigeiner App automatisch generieren: Ab Android Studio Giraffe Canary 7 und AGP 8.1.0-alpha07 können Sie Ihre App so konfigurieren, dass Spracheinstellungen für einzelne Apps automatisch unterstützt werden. Basierend auf Ihren Projektressourcen generiert das Android-Gradle-Plug-in dieLocaleConfig-Datei und fügt in der endgültigen Manifestdatei einen Verweis darauf hinzu. Sie müssen die Datei also nicht mehr manuell erstellen oder aktualisieren. AGP verwendet die Ressourcen in denres-Ordnern Ihrer App-Module sowie alle Bibliotheksmodulabhängigkeiten, um die Sprachen zu bestimmen, die in dieLocaleConfig-Datei aufgenommen werden sollen.Dynamische Updates für die

localeConfigeiner App: Verwenden Sie die MethodensetOverrideLocaleConfig()undgetOverrideLocaleConfig()inLocaleManager, um die Liste der unterstützten Sprachen Ihrer App in den Systemeinstellungen des Geräts dynamisch zu aktualisieren. Nutzen Sie diese Flexibilität, um die Liste der unterstützten Sprachen für jede Region anzupassen, A/B-Tests auszuführen oder eine aktualisierte Liste von Sprachen bereitzustellen, wenn Ihre Anwendung serverseitige Push-Vorgänge für die Lokalisierung verwendet.Sichtbarkeit der App-Sprache für Eingabemethoden-Editoren (IMEs): IMEs können mit der Methode

getApplicationLocales()die Sprache der aktuellen Anwendung prüfen und die IME-Sprache dieser Sprache zuordnen.

Grammatical Inflection API

3 Milliarden Menschen sprechen Geschlechtssprachen: Sprachen, in denen sich grammatische Kategorien wie Substantive, Verben, Adjektive und Präpositionen nach dem Geschlecht der Personen und Objekte widerspiegeln, mit denen Sie sprechen oder über die Sie sprechen. Traditionell wird in vielen geschlechtsspezifischen Sprachen das männliche grammatische Genus als Standardgenerierung oder generisches Geschlecht verwendet.

Wenn Sie Nutzer mit dem falschen grammatikalischen Geschlecht ansprechen, z. B. Frauen im männlichen grammatikalischen Geschlecht, kann sich dies negativ auf Leistung und Einstellung auswirken. Im Gegensatz dazu kann eine Benutzeroberfläche mit einer Sprache, die das grammatikalische Geschlecht des Nutzers korrekt wiedergibt, die Nutzerinteraktion verbessern und eine personalisiertere und natürlich klingende Nutzererfahrung bieten.

In Android 14 wird die Grammatical Inflection API eingeführt, um Ihnen beim Erstellen einer nutzerorientierten UI für geschlechtsspezifische Sprachen zu helfen. Damit können Sie die Genusssprache unterstützen, ohne Ihre App refaktorieren zu müssen.

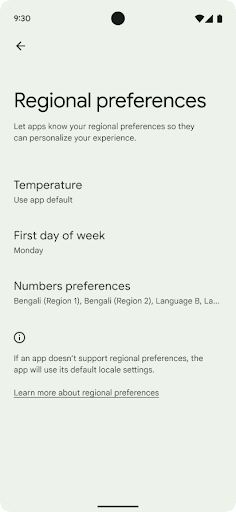

Regionale Präferenzen

Mit regionalen Einstellungen können Nutzer Temperatureinheiten, den ersten Tag der Woche und Nummerierungssysteme personalisieren. Ein Europäer, der in den USA lebt, bevorzugt Temperatureinheiten in Celsius statt Fahrenheit. Außerdem wird der Montag in Apps statt des US-Standards Sonntag als Wochenbeginn behandelt.

Die neuen Android-Einstellungsmenüs für diese Einstellungen bieten Nutzern einen leicht auffindbaren und zentralen Ort, an dem sie die App-Einstellungen ändern können. Diese Einstellungen bleiben auch durch Sichern und Wiederherstellen erhalten. Verschiedene APIs und Intents – z. B. getTemperatureUnit und getFirstDayOfWeek – gewähren deiner App Lesezugriff auf Nutzereinstellungen, damit deine App die Darstellung von Informationen anpassen kann. Sie können auch ein BroadcastReceiver auf ACTION_LOCALE_CHANGED registrieren, um Änderungen der Sprachkonfiguration zu verarbeiten, wenn sich regionale Einstellungen ändern.

Diese Einstellungen finden Sie in den Einstellungen unter System > Sprachen und Eingabe > Regionale Einstellungen.

Barrierefreiheit

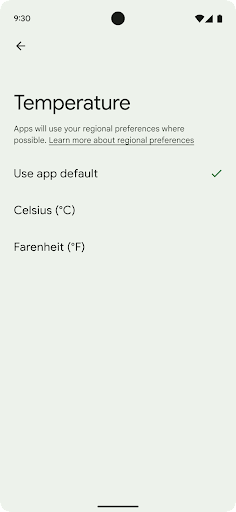

Nicht lineare Schriftskalierung auf 200%

Ab Android 14 unterstützt das System eine Schriftskalierung von bis zu 200 % und bietet Nutzern mit eingeschränktem Sehvermögen zusätzliche Optionen für Bedienungshilfen, die den Richtlinien für barrierefreie Webinhalte (Web Content Accessibility Guidelines, WCAG) entsprechen.

Um zu verhindern, dass große Textelemente auf dem Bildschirm zu groß werden, wendet das System eine nicht lineare Skalierungskurve an. Bei dieser Skalierungsstrategie wird großer Text nicht mit derselben Geschwindigkeit wie kleinerer Text skaliert. Eine nicht lineare Schriftskalierung trägt dazu bei, die proportionale Hierarchie zwischen Elementen unterschiedlicher Größe beizubehalten, während gleichzeitig Probleme mit der Skalierung des linearen Texts bei hohen Graden (z. B. abgeschnittener Text oder Text, der aufgrund einer extrem großen Anzeigegröße schwerer zu lesen ist) minimiert werden.

App mit nicht linearer Schriftskalierung testen

Wenn Sie bereits skalierte Pixeleinheiten (sp) zur Definition der Textgröße verwenden, werden diese zusätzlichen Optionen und Skalierungsverbesserungen automatisch auf den Text in Ihrer App angewendet. Sie sollten jedoch UI-Tests mit aktivierter maximaler Schriftgröße (200%) durchführen, um sicherzustellen, dass in Ihrer App die Schriftgrößen korrekt angewendet werden und größere Schriftgrößen ohne Beeinträchtigung der Nutzerfreundlichkeit verwendet werden können.

So aktivieren Sie eine Schriftgröße von 200 %:

- Öffnen Sie die Einstellungen und rufen Sie Bedienungshilfen > Anzeigegröße und Text auf.

- Tippen Sie für die Option Schriftgröße auf das Pluszeichen (+), bis die Einstellung für die maximale Schriftgröße aktiviert ist, wie in der Abbildung zu diesem Abschnitt gezeigt.

Skalierte Pixeleinheiten (sp) für Textgrößen verwenden

Denken Sie daran, Textgrößen immer in sp-Einheiten anzugeben. Wenn deine App sp-Einheiten verwendet, kann Android die vom Nutzer bevorzugte Textgröße anwenden und entsprechend skalieren.

Verwenden Sie keine sp-Einheiten für die Füllung und definieren Sie die Ansichtshöhe nicht unter der Annahme, dass ein impliziter Abstand erforderlich ist: Bei nicht linearer Schriftskalierung sind die sp-Abmessungen möglicherweise nicht proportional, sodass 4sp + 20 sp nicht gleich 24 sp sein kann.

Skalierte Pixeleinheiten (sp) umrechnen

Verwenden Sie TypedValue.applyDimension(), um von sp-Einheiten in Pixel zu konvertieren, und TypedValue.deriveDimension(), um Pixel in sp umzuwandeln. Mit diesen Methoden wird die entsprechende nicht lineare Skalierungskurve automatisch angewendet.

Vermeiden Sie die Hartcodierung von Gleichungen mit Configuration.fontScale oder DisplayMetrics.scaledDensity. Da die Schriftskalierung nicht linear ist, ist das Feld scaledDensity nicht mehr genau. Das Feld fontScale sollte nur zu Informationszwecken verwendet werden, da Schriftarten nicht mehr mit einem einzelnen Skalarwert skaliert werden.

sp-Einheiten für lineHeight verwenden

Definieren Sie android:lineHeight immer mit sp-Einheiten anstelle von dp, damit die Linienhöhe mit dem Text skaliert wird. Wenn der Text „sp“ ist, aber lineHeight in dp oder px angegeben ist, wird er nicht skaliert und sieht zu eng aus.

TextView korrigiert lineHeight automatisch, sodass die gewünschten Proportionen erhalten bleiben. Dies gilt jedoch nur, wenn sowohl textSize als auch lineHeight in sp-Einheiten definiert sind.

Kamera und Medien

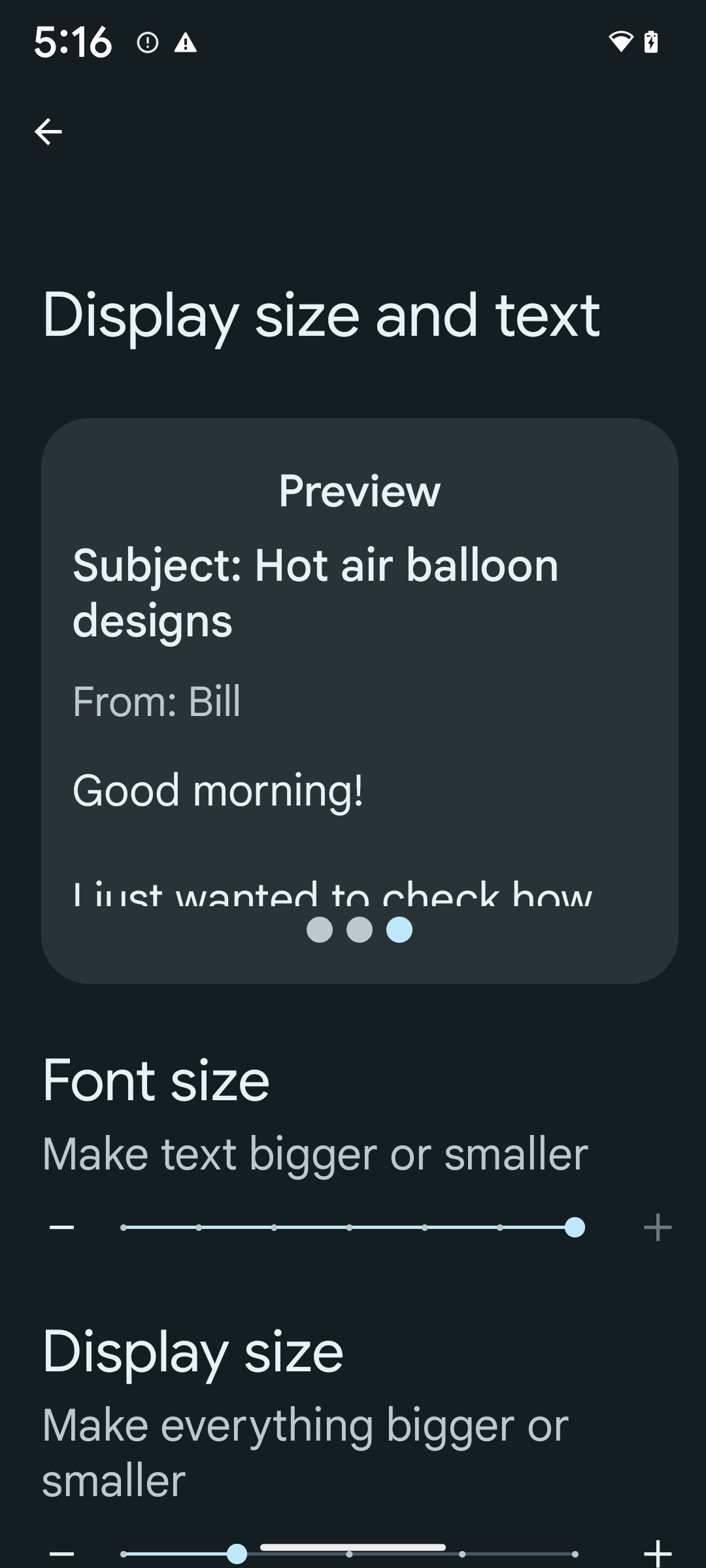

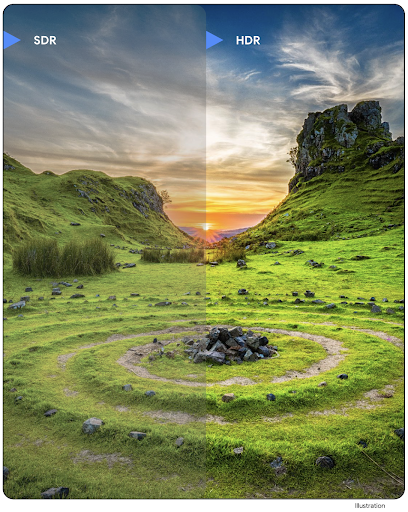

Ultra HDR für Bilder

Unter Android 14 werden jetzt HDR-Bilder (High Dynamic Range) unterstützt, bei denen beim Aufnehmen eines Fotos mehr Informationen vom Sensor gespeichert werden. Dadurch sind leuchtende Farben und ein größerer Kontrast möglich. Android verwendet das Ultra HDR-Format, das vollständig abwärtskompatibel mit JPEG-Bildern ist. Dadurch können Apps nahtlos mit HDR-Bildern zusammenarbeiten und sie bei Bedarf in Standard Dynamic Range (SDR) anzeigen.

Das Rendern dieser Bilder in der HDR-Benutzeroberfläche erfolgt automatisch durch das Framework, wenn in Ihrer App die HDR-UI für das Aktivitätsfenster aktiviert wird. Dies erfolgt entweder über einen Manifesteintrag oder während der Laufzeit durch Aufruf von Window.setColorMode(). Auf unterstützten Geräten können Sie auch komprimierte Ultra-HDR-Standbilder aufnehmen. Da der Sensor mehr Farben zurückgewinnt, lässt sich die Bearbeitung im Nachhinein flexibler. Die mit Ultra HDR-Bildern verbundenen Gainmap können verwendet werden, um sie mit OpenGL oder Vulkan zu rendern.

Zoom, Fokus, PostView und mehr in Kamera-Erweiterungen

Unter Android 14 werden Kameraerweiterungen aktualisiert und verbessert, sodass Apps längere Verarbeitungszeiten bewältigen können. Außerdem werden auf unterstützten Geräten mithilfe von rechenintensiven Algorithmen wie Fotografie bei schlechten Lichtverhältnissen verbesserte Bilder ermöglicht. Diese Funktionen bieten Nutzern eine noch robustere Erfahrung bei Verwendung von Kameraerweiterungen. Beispiele für diese Verbesserungen:

- Die Schätzung der Verarbeitungslatenz dynamischer Erfassungsvorgänge bietet dennoch viel genauere Erfassungslatenzschätzungen auf der Grundlage der aktuellen Szene und der Umgebungsbedingungen. Rufen Sie

CameraExtensionSession.getRealtimeStillCaptureLatency()auf, um einStillCaptureLatency-Objekt mit zwei Latenzschätzungsmethoden zu erhalten. Die MethodegetCaptureLatency()gibt die geschätzte Latenz zwischenonCaptureStartedundonCaptureProcessStarted()zurück. Die MethodegetProcessingLatency()gibt die geschätzte Latenz zwischenonCaptureProcessStarted()und dem endgültigen verarbeiteten Frame zurück, der verfügbar ist. - Unterstützung für Callbacks zum Erfassen des Fortschritts, damit Anwendungen den aktuellen Fortschritt von Verarbeitungsvorgängen mit langer Ausführungszeit, die noch erfasst werden, anzeigen können. Sie können mit

CameraExtensionCharacteristics.isCaptureProcessProgressAvailableprüfen, ob dieses Feature verfügbar ist. Ist dies der Fall, implementieren Sie denonCaptureProcessProgressed()-Callback, dem der Fortschritt (von 0 bis 100) als Parameter übergeben wird. Erweiterungsspezifische Metadaten wie

CaptureRequest.EXTENSION_STRENGTHzum Einstellen der Intensität eines Erweiterungseffekts, z. B. die Intensität der Weichzeichnung des Hintergrunds mitEXTENSION_BOKEH.Postview-Funktion für Still Capture in Kameraerweiterungen, mit der ein weniger verarbeitetes Bild schneller als das endgültige Bild bereitgestellt wird. Wenn eine Erweiterung die Verarbeitungslatenz erhöht, kann ein Postview-Bild als Platzhalter bereitgestellt werden, um die Nutzerfreundlichkeit zu verbessern. Später kann es dann für das fertige Bild verwendet werden. Mit

CameraExtensionCharacteristics.isPostviewAvailablekönnen Sie prüfen, ob dieses Feature verfügbar ist. Anschließend können Sie einOutputConfigurationanExtensionSessionConfiguration.setPostviewOutputConfigurationübergeben.Die Unterstützung für

SurfaceViewermöglicht einen optimierten und energieeffizienten Vorschau-Renderingpfad.Unterstützung für das Tippen zum Fokussieren und Zoomen während der Verwendung der Erweiterung.

Integrierter Zoom

Wenn REQUEST_AVAILABLE_CAPABILITIES_STREAM_USE_CASE in CameraCharacteristics SCALER_AVAILABLE_STREAM_USE_CASES_CROPPED_RAW enthält, kann Ihre App mithilfe erweiterter Sensorfunktionen für einen zugeschnittenen RAW-Stream dieselben Pixel wie das gesamte Sichtfeld ausgeben. Dazu wird ein CaptureRequest mit einem RAW-Ziel verwendet, für das der Anwendungsfall für den Stream auf CameraMetadata.SCALER_AVAILABLE_STREAM_USE_CASES_CROPPED_RAW festgelegt ist.

Durch Implementierung der Steuerelemente zum Überschreiben von Anfragen bietet die aktualisierte Kamera Nutzern eine Zoomsteuerung, noch bevor andere Kamerasteuerelemente bereit sind.

Verlustfreier USB-Audio

Android 14 unterstützt verlustfreie Audioformate für audiophile Wiedergaben über kabelgebundene USB-Headsets. Sie können ein USB-Gerät nach den bevorzugten Mischpultattributen abfragen, einen Listener für Änderungen der bevorzugten Mischpultattribute registrieren und Mischgeräteattribute mithilfe der Klasse AudioMixerAttributes konfigurieren. Diese Klasse stellt das Format dar, z. B. Kanalmaske, Abtastrate und Verhalten des Audiomixers. Mit dieser Klasse können Audioinhalte direkt ohne Vermischung, Lautstärkeanpassung oder Verarbeitungseffekte gesendet werden.

Produktivität der Entwicklungsteams und Tools

Anmeldedaten-Manager

Unter Android 14 wird der Credential Manager als Plattform-API hinzugefügt. Geräte mit Android 4.4 (API-Level 19) werden über eine Jetpack-Bibliothek mit Google Play-Diensten wieder unterstützt. Der Credential Manager soll Nutzern die Anmeldung erleichtern. Dazu werden APIs verwendet, die Anmeldedaten bei von Nutzern konfigurierten Anmeldedatenanbietern abrufen und speichern. Die Anmeldedatenverwaltung unterstützt mehrere Anmeldemethoden, darunter Nutzername und Passwort, Passkeys und Lösungen für föderierte Anmeldungen (z. B. „Über Google anmelden“) in einer einzigen API.

Passkeys bieten viele Vorteile. Passkeys basieren beispielsweise auf Branchenstandards, können mit verschiedenen Betriebssystemen und Browsern sowie auf Websites und in Apps verwendet werden.

Weitere Informationen finden Sie in der Dokumentation zu Anmeldedatenmanager und Passkeys und im Blogpost zur Anmeldedatenverwaltung und Passkeys.

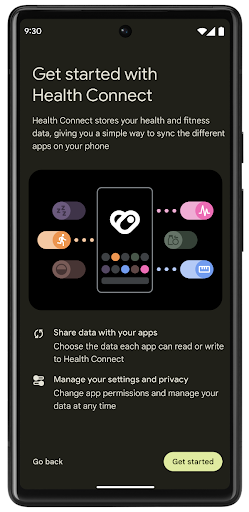

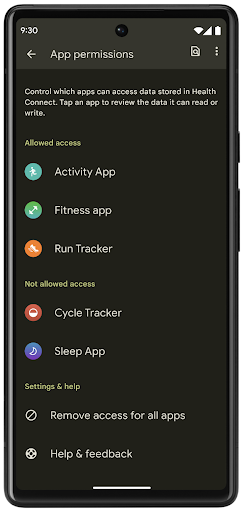

Health Connect

Health Connect ist ein On-Device-Repository für Gesundheits- und Fitnessdaten von Nutzern. Nutzer können damit Daten zwischen ihren bevorzugten Anwendungen teilen. Sie können zentral steuern, welche Daten mit diesen Anwendungen geteilt werden sollen.

Auf Geräten mit Android-Versionen vor Android 14 kann Health Connect als App im Google Play Store heruntergeladen werden. Ab Android 14 ist Health Connect Teil der Plattform und erhält Updates über Google Play-Systemupdates, ohne dass ein separater Download erforderlich ist. Health Connect kann so häufig aktualisiert werden und deine Apps können darauf vertrauen, dass Health Connect auf Geräten mit Android 14 oder höher verfügbar ist. Nutzer können über die Einstellungen ihres Geräts auf Health Connect zugreifen. Die Datenschutzeinstellungen sind in die Systemeinstellungen integriert.

Health Connect enthält mehrere neue Funktionen in Android 14, z. B. Trainingsrouten, mit denen Nutzer eine Strecke ihres Trainings teilen können, die auf einer Karte visualisiert werden kann. Eine Route ist als Liste von Orten definiert, die innerhalb eines Zeitfensters gespeichert werden. Deine App kann Routen in Trainingssitzungen einfügen und diese miteinander verknüpfen. Damit Nutzer die vollständige Kontrolle über diese sensiblen Daten haben, müssen sie die Freigabe einzelner Routen für andere Anwendungen zulassen.

Weitere Informationen finden Sie in der Dokumentation zu Health Connection und im Blogpost zu Neu bei Android Health.

OpenJDK 17-Updates

Unter Android 14 werden die Kernbibliotheken von Android fortlaufend aktualisiert, damit sie den Funktionen der neuesten OpenJDK-LTS-Releases entsprechen. Dazu gehören sowohl Bibliotheksupdates als auch die Java 17-Sprachunterstützung für App- und Plattformentwickler.

Folgende Funktionen und Verbesserungen wurden eingeführt:

- Aktualisierung von ca. 300

java.base-Klassen auf Java 17-Unterstützung. - Textblocks, die mehrzeilige Stringliterale in die Programmiersprache Java einführen.

- Musterabgleich für „instanceof“, mit dem ein Objekt in einer

instanceofohne zusätzliche Variablen so behandelt werden kann, als hätte es einen bestimmten Typ. - Versiegelte Klassen, mit denen Sie einschränken können, welche Klassen und Schnittstellen sie erweitern oder implementieren können.

Dank Google Play-Systemupdates (Project Mainline) erhalten über 600 Millionen Geräte die neuesten ART-Updates (Android Runtime) mit diesen Änderungen. Dies ist Teil unserer Bemühungen, Anwendungen geräteübergreifend eine einheitlichere, sicherere Umgebung zu bieten und Nutzern unabhängig von Plattform-Releases neue Features und Funktionen bereitzustellen.

Java und OpenJDK sind Marken oder eingetragene Marken von Oracle und/oder seinen Tochtergesellschaften.

Verbesserungen für App-Shops

Mit Android 14 werden mehrere PackageInstaller APIs eingeführt, mit denen App-Shops die Nutzerfreundlichkeit verbessern können.

Vor dem Download Genehmigung für die Installation anfordern

Für die Installation oder Aktualisierung einer App ist möglicherweise die Nutzergenehmigung erforderlich.

Das ist beispielsweise der Fall, wenn ein Installationsprogramm, das die Berechtigung REQUEST_INSTALL_PACKAGES verwendet, versucht, eine neue App zu installieren. Bei älteren Android-Versionen können App-Shops die Nutzergenehmigung nur anfordern, nachdem APKs in die Installationssitzung geschrieben und für die Sitzung ein Commit erstellt wurde.

Ab Android 14 können Installationsprogramme mit der Methode requestUserPreapproval() die Nutzergenehmigung anfordern, bevor die Installationssitzung durchgeführt wird. Durch diese Verbesserung kann ein App-Shop das Herunterladen von APKs so lange zurückstellen, bis die Installation vom Nutzer genehmigt wurde. Sobald ein Nutzer die Installation genehmigt hat, kann der App-Shop die App außerdem im Hintergrund herunterladen und installieren, ohne den Nutzer zu unterbrechen.

Verantwortung für zukünftige Updates übernehmen

Mit der Methode setRequestUpdateOwnership() kann ein Installationsprogramm dem System mitteilen, dass es für zukünftige Updates einer installierten App verantwortlich sein soll. Mit dieser Funktion kann die Inhaberschaft für Updates erzwungen werden. Das bedeutet, dass nur der Inhaber des Updates automatische Updates für die App installieren darf. Dadurch wird sichergestellt, dass Nutzer nur Updates aus dem erwarteten App-Shop erhalten.

Alle anderen Installateure, einschließlich solchen, die die Berechtigung INSTALL_PACKAGES verwenden, müssen eine ausdrückliche Nutzergenehmigung einholen, um ein Update zu installieren. Wenn ein Nutzer mit einem Update aus einer anderen Quelle fortfährt, geht die Inhaberschaft für die Aktualisierung verloren.

Apps zu weniger Störungen aktualisieren

App-Shops möchten in der Regel vermeiden, eine Anwendung zu aktualisieren, die aktiv verwendet wird, da dies dazu führt, dass die laufenden Prozesse der Anwendung beendet werden, was möglicherweise zu Unterbrechungen beim Nutzer führt.

Ab Android 14 bietet die InstallConstraints API Nutzern die Möglichkeit, App-Updates zu einem geeigneten Zeitpunkt durchzuführen. Ein App-Shop kann beispielsweise die Methode commitSessionAfterInstallConstraintsAreMet() aufrufen, damit für ein Update nur dann ein Commit durchgeführt wird, wenn der Nutzer nicht mehr mit der betreffenden App interagiert.

Optionale Splits nahtlos installieren

Mit unterteilten APKs können die Funktionen einer App in separaten APK-Dateien statt als monolithisches APK bereitgestellt werden. Mit geteilten APKs können App-Shops die Bereitstellung verschiedener App-Komponenten optimieren. Beispielsweise können App-Shops eine Optimierung basierend auf den Eigenschaften des Zielgeräts durchführen. Die PackageInstaller API unterstützt Splits seit ihrer Einführung in API-Level 22.

In Android 14 kann ein Installationsprogramm mit der Methode setDontKillApp() angeben, dass die laufenden Prozesse der App bei der Installation neuer Splits nicht beendet werden sollen. App-Shops können diese Funktion nutzen, um neue Funktionen einer App nahtlos zu installieren, während der Nutzer die App verwendet.

App-Metadaten-Bundles

Ab Android 14 kannst du mit dem Installationsprogramm für das Android-Paket App-Metadaten angeben, z. B. Praktiken zur Datensicherheit, die auf App-Store-Seiten wie Google Play enthalten sein sollen.

Erkennen, wenn Nutzer Screenshots auf dem Gerät machen

Um die Erkennung von Screenshots standardisiert zu gestalten, wird in Android 14 eine datenschutzfreundliche API zur Screenshoterkennung eingeführt. Mit dieser API können Apps Callbacks pro Aktivität registrieren. Diese Callbacks werden aufgerufen und der Nutzer wird benachrichtigt, wenn er einen Screenshot aufnimmt, während diese Aktivität sichtbar ist.

Nutzererfahrung

Benutzerdefinierte Aktionen und verbessertes Ranking auf Sharesheet

Unter Android 14 wird das System-Sharesheet aktualisiert, um benutzerdefinierte App-Aktionen und informativere Vorschauergebnisse für Nutzer zu unterstützen.

Benutzerdefinierte Aktionen hinzufügen

Mit Android 14 können über deine App dem aufgerufenen System-Sharesheet benutzerdefinierte Aktionen hinzugefügt werden.

Ranking von Direct Share-Zielen verbessern

Android 14 verwendet mehr Signale von Apps, um das Ranking der Ziele für direkten Anteil zu bestimmen, um dem Nutzer hilfreichere Ergebnisse zu liefern. Um das nützlichste Signal für das Ranking zu erhalten, folgen Sie der Anleitung zur Verbesserung des Rankings Ihrer Direct Share-Ziele. Kommunikations-Apps können auch die Verknüpfungsnutzung für ausgehende und eingehende Nachrichten melden.

Unterstützung für integrierte und benutzerdefinierte Animationen für die Funktion „Predictive Back“

Mit Android 13 wurde die vorausschauende Back-to-Home-Animation hinter einer Entwickleroption eingeführt. Bei Verwendung in einer unterstützten App mit aktivierter Entwickleroption wird durch das Zurückwischen eine Animation angezeigt, die darauf hinweist, dass durch die Zurück-Geste die App zurück zum Startbildschirm beendet wird.

Android 14 umfasst mehrere Verbesserungen und neue Anleitungen für die Funktion „Predictive Back“:

- Sie können

android:enableOnBackInvokedCallback=trueso konfigurieren, dass die Vorhersage von Systemanimationen pro Aktivität statt für die gesamte App aktiviert wird. - Wir haben neue Systemanimationen hinzugefügt, die die Back-to-Home-Animation von Android 13 ergänzen. Die neuen Systemanimationen sind aktivitäts- und aufgabenübergreifend und erhalten nach der Migration zu Predictive Back automatisch.

- Wir haben neue Animationen für Materialkomponenten für Tabellen unten, Seitenblätter und die Suche hinzugefügt.

- Wir haben Designanleitungen zum Erstellen benutzerdefinierter In-App-Animationen und -Übergänge erstellt.

- Wir haben neue APIs hinzugefügt, um benutzerdefinierte In-App-Übergangsanimationen zu unterstützen:

handleOnBackStarted,handleOnBackProgressed,handleOnBackCancelledinOnBackPressedCallbackonBackStarted,onBackProgressed,onBackCancelledinOnBackAnimationCallback- Für Übergänge, die reagieren, wenn der Nutzer zurückwischt, solltest du

overrideActivityTransitionanstelle vonoverridePendingTransitionverwenden.

In dieser Vorabversion von Android 14 verbleiben alle Funktionen von Predictive Back einer Entwickleroption. Weitere Informationen finden Sie im Entwicklerleitfaden für die Migration Ihrer App zur Vorhersage wieder zurück und im Entwicklerleitfaden zum Erstellen benutzerdefinierter In-App-Übergänge.

App-Überschreibung durch Gerätehersteller als Großbildschirm

Mit App-Überschreibungen können Gerätehersteller das Verhalten von Apps auf Geräten mit großen Bildschirmen ändern. Die Überschreibung FORCE_RESIZE_APP weist das System beispielsweise an, die Größe der App an die Displayabmessungen anzupassen (unter Vermeidung von Größenkompatibilitätsmodus), auch wenn resizeableActivity="false" im App-Manifest festgelegt ist.

Überschreibungen sollen die Nutzererfahrung auf großen Bildschirmen verbessern.

Mit den neuen Manifesteigenschaften können Sie einige Überschreibungen des Geräteherstellers für Ihre App deaktivieren.

Überschreibungen pro App für Nutzer auf großen Bildschirmen

App-bezogene Überschreibungen ändern das Verhalten von Apps auf Geräten mit großen Bildschirmen. Die Überschreibung des Geräteherstellers OVERRIDE_MIN_ASPECT_RATIO_LARGE legt beispielsweise das Seitenverhältnis der App auf 16:9 fest, unabhängig von der Konfiguration der App.

Mit Android 14 QPR1 können Nutzer auf Geräten mit großen Bildschirmen über ein neues Einstellungsmenü Überschreibungen pro App vornehmen.

App-Bildschirmfreigabe

Mit der App-Bildschirmfreigabe können Nutzer während der Aufzeichnung von Bildschirminhalten ein App-Fenster teilen, anstatt den gesamten Bildschirm des Geräts.

Bei der App-Bildschirmfreigabe werden die Statusleiste, die Navigationsleiste, Benachrichtigungen und andere Elemente der System-UI von der gemeinsam genutzten Anzeige ausgeschlossen. Nur der Inhalt der ausgewählten App wird geteilt.

Die App-Bildschirmfreigabe verbessert die Produktivität und den Datenschutz, da Nutzer mehrere Apps ausführen können, die Freigabe von Inhalten aber auf eine einzige App beschränkt wird.

Intelligente Antwort auf Basis von LLM auf Pixel 8 Pro in Gboard

Auf Pixel 8 Pro-Geräten mit dem Feature Drop für Dezember können Entwickler qualitativ hochwertigere intelligente Antworten in Gboard ausprobieren, die auf Large Language Models (LLMs) auf dem Gerät basieren, die auf Google Tensor laufen.

Diese Funktion ist als eingeschränkte Vorabversion für US-Englisch in WhatsApp, Line und KakaoTalk verfügbar. Hierfür ist ein Pixel 8 Pro-Gerät mit Gboard als Tastatur erforderlich.

Wenn Sie die Funktion ausprobieren möchten, aktivieren Sie zuerst die Funktion unter Settings > Developer Options > AiCore Settings > Enable Aicore Persistent.

Öffnen Sie als Nächstes eine Unterhaltung in einer unterstützten Anwendung, um eingehende Nachrichten mit der LLM-basierten intelligenten Antwort in der Vorschlagsleiste von Gboard zu sehen.

Grafik

Pfade sind abfragbar und interpolierbar

Die Path API von Android ist ein leistungsstarker und flexibler Mechanismus zum Erstellen und Rendern von Vektorgrafiken. Sie können damit einen Pfad streichen oder füllen, einen Pfad aus Liniensegmenten oder quadratischen oder kubischen Kurven konstruieren, boolesche Operationen ausführen, um noch komplexere Formen zu erhalten, oder alle diese gleichzeitig. Eine Einschränkung besteht darin, herauszufinden, was sich tatsächlich in einem Pfadobjekt befindet. Das Innere des Objekts ist nach der Erstellung für Aufrufer nicht sichtbar.

Zum Erstellen eines Path rufen Sie Methoden wie moveTo(), lineTo() und cubicTo() auf, um Pfadsegmente hinzuzufügen. Es gab jedoch keine Möglichkeit, diesen Pfad nach den Segmenten zu fragen. Daher müssen Sie diese Informationen beim Erstellen aufbewahren.

Ab Android 14 können Sie Pfade abfragen, um herauszufinden, was darin enthalten ist.

Zuerst müssen Sie mit der Path.getPathIterator API ein PathIterator-Objekt abrufen:

Kotlin

val path = Path().apply {

moveTo(1.0f, 1.0f)

lineTo(2.0f, 2.0f)

close()

}

val pathIterator = path.pathIterator

Java

Path path = new Path(); path.moveTo(1.0F, 1.0F); path.lineTo(2.0F, 2.0F); path.close(); PathIterator pathIterator = path.getPathIterator();

Als Nächstes können Sie PathIterator aufrufen, um die Segmente nacheinander durchzugehen und alle erforderlichen Daten für jedes Segment abzurufen. In diesem Beispiel werden PathIterator.Segment-Objekte verwendet, die die Daten für Sie bündeln:

Kotlin

for (segment in pathIterator) {

println("segment: ${segment.verb}, ${segment.points}")

}

Java

while (pathIterator.hasNext()) {

PathIterator.Segment segment = pathIterator.next();

Log.i(LOG_TAG, "segment: " + segment.getVerb() + ", " + segment.getPoints());

}

PathIterator hat auch eine nicht zugewiesene Version von next(), in der Sie einen Zwischenspeicher übergeben können, der die Punktdaten enthält.

Einer der wichtigen Anwendungsfälle für die Abfrage von Path-Daten ist die Interpolation. So können Sie beispielsweise zwischen zwei verschiedenen Pfaden animiert (oder morph). Um diesen Anwendungsfall weiter zu vereinfachen, enthält Android 14 auch die Methode interpolate() für Path. Wenn die beiden Pfade dieselbe interne Struktur haben, erstellt die Methode interpolate() eine neue Path mit diesem interpolierten Ergebnis. In diesem Beispiel wird ein Pfad zurückgegeben, dessen Form zwischen path und otherPath auf halber Strecke liegt (lineare Interpolation von 0,5):

Kotlin

val interpolatedResult = Path()

if (path.isInterpolatable(otherPath)) {

path.interpolate(otherPath, .5f, interpolatedResult)

}

Java

Path interpolatedResult = new Path();

if (path.isInterpolatable(otherPath)) {

path.interpolate(otherPath, 0.5F, interpolatedResult);

}

Die graphics-path-Bibliothek von Jetpack ermöglicht auch für frühere Android-Versionen ähnliche APIs.

Benutzerdefinierte Mesh-Netzwerke mit Vertex- und Fragment-Shadern

Android hat schon lange das Zeichnen von Dreiecksnetzen mit benutzerdefinierter Schattierung unterstützt, das Format des Eingabe-Mesh-Netzwerks war jedoch auf einige vordefinierte Attributkombinationen beschränkt. Mit Android 14 werden benutzerdefinierte Mesh-Netzwerke unterstützt, die als Dreiecken oder Dreiecksstreifen definiert und optional indexiert werden können. Diese Mesh-Netzwerke werden mit benutzerdefinierten Attributen, Vertex-Schritten, variiert sowie Vertex- und Fragment-Shader in AGSL spezifiziert.

Der Vertex-Shader definiert die Variationen, wie Position und Farbe, während der Fragment-Shader optional die Farbe für das Pixel definieren kann. Dies geschieht in der Regel anhand der vom Vertex-Shader erzeugten Abweichungen. Wenn vom Fragment-Shader eine Farbe bereitgestellt wird, wird diese im Mischmodus, der beim Zeichnen des Mesh-Netzwerks ausgewählt wurde, mit der aktuellen Paint-Farbe gemischt. Für zusätzliche Flexibilität können Uniformen an das Fragment und an die Vertex-Shader übergeben werden.

Hardwarepuffer-Renderer für Canvas

Damit du die Canvas API von Android nutzen kannst, um mit Hardwarebeschleunigung in HardwareBuffer zu zeichnen, wird in Android 14 HardwareBufferRenderer eingeführt. Diese API ist besonders nützlich, wenn Ihr Anwendungsfall die Kommunikation mit dem Systemcompositor über SurfaceControl zum Zeichnen mit niedriger Latenz umfasst.